Des hypertrucages (deepfakes) qui imitent parfaitement la voix et le visage, des photos compromettantes créées de toutes pièces, des textes trompeurs générés en quantité industrielle… Les progrès de l’intelligence artificielle générative ne cessent de se multiplier ces dernières années. Le système de génération vidéo Sora, lancé en février 2024 par OpenAI, n’en est que le plus récent exemple. On atteint un réalisme tel que le Forum économique mondial de Davos considère désormais l’IA comme une des menaces les plus importantes pour l’humanité, au même niveau que les guerres ou le climat. Une menace qui pourrait s’accentuer cette année, alors que des élections auront lieu dans près de 70 pays.

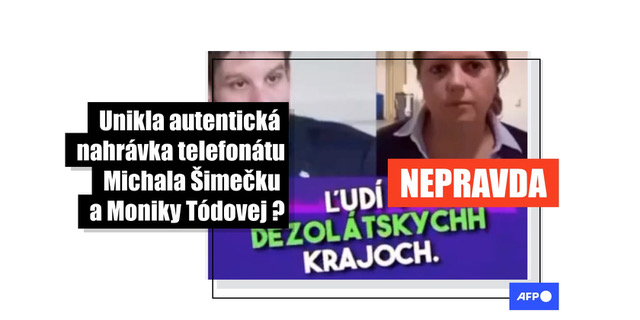

« C’est un peu l’année de tous les dangers », estime Vincent Berthier, responsable du bureau technologies à Reporters sans frontières (RSF). Il en tient pour preuve l’exemple de la Slovaquie où, en septembre dernier, un hypertrucage audio sur de supposés achats de vote entre un candidat de l’opposition et une journaliste a probablement changé le cours du second tour des élections législatives. « C’était une première dans l’histoire des démocraties. Tout le monde s’inquiétait des deepfakes vidéo mais ce sont peut-être les deepfakes audio qui pourraient causer le plus de problèmes. Ils peuvent convaincre plus facilement », explique Vincent Berthier.

Le candidat slovaque en question a finalement perdu malgré une avance dans les sondages. Faut-il y voir un lien? Difficile à dire, mais ce qui est certain c’est que les risques sont bien réels. « Il y a des recherches qui montrent que juste entendre parler de désinformation, savoir qu’il y en a et que ça circule de plus en plus, cela a déjà un impact sur le public, comme augmenter la méfiance et avoir moins confiance dans les médias traditionnels », explique Marie-Eve Carignan, professeure au département de communication à l’Université Sherbrooke.

Le rapport 2024 de Reuters, Tendances et prédictions du journalisme, des médias et de la technologie, avance d’ailleurs que la plupart des dirigeants de médias pensent que l’IA aura un impact négatif sur la confiance du public envers l’information. Dans un sondage réalisé pour ce rapport, 31% des dirigeants de médias anticipent une baisse importante de cette confiance.

Une technologie de plus en plus réaliste

Autre exemple, il y a quelques semaines aux États-Unis. En pleine primaire, des électeurs démocrates du New Hampshire reçoivent un appel téléphonique. Au bout du fil, Joe Biden, ou plutôt une voix similaire à celle du président américain. Créée de toute pièce, cette voix les incite à ne pas se déplacer pour voter. Une enquête pour tentative illégale de perturber le scrutin a depuis été ouverte et les appels effectués avec des voix générées par l’IA ont désormais été interdits par le régulateur américain des télécoms.

« Il va y avoir de plus en plus », prévient Jeff Yates, journaliste à l’émission Les Décrypteurs à Radio-Canada. « C’est devenu tellement facile à générer. Tout ce qu’il faut c’est une minute de la voix de la personne pour la cloner. Ça copie même le ton de la voix et sa façon de parler et le résultat est quand même assez bon, surtout en anglais, un peu moins en français. »

Près de six adultes américains sur dix pensent d’ailleurs que l’IA pourrait faire augmenter la désinformation au cours de la campagne électorale, selon un sondage du Centre de recherche sur les affaires publiques Associated Press-NORC et de l’École de politiques publiques Harris de l’Université de Chicago.

Au-delà des risques sur le vote, la désinformation aurait aussi un impact sur la bonne santé des sociétés démocratiques. « On voit déjà dans des sondages qu’il y a des gens qui pensent que le système autoritaire serait mieux que le système démocratique. […] C’est sûr que quand on est exposé à des choses fausses, qui vont souvent jouer avec la confiance envers le système, ça n’aide pas vraiment. Il y a de grands risques démocratiques », s’inquiète la professeure Marie-Eve Carignan.

Des solutions?

Depuis les derniers mois, le conflit Israël/Hamas a aussi entraîné la diffusion de nombreuses fausses images, fabriquées de toutes pièces ou provenant d’autres conflits, tout ça à des fins de propagande. Autre phénomène en augmentation, celui de faux sites internet d’actualité entièrement générés par l’IA et qui arrivent souvent en tête des recherches. « On pourrait imaginer le scénario d’un article hyper dommageable pour un parti. Les opposants génèrent des centaines d’articles par ChatGPT pour masquer les résultats de recherche. Ce n’était pas possible il y a encore deux ou trois ans, mais là ce sont des outils clefs en main, disponibles pour tout le monde et pas très cher », détaille Jeff Yates.

Alors que la distinction entre le vrai et le faux semble parfois de plus en plus difficile, Reporters sans frontières (RSF) a lancé la Journalism Trust Initiative (JTI), une sorte de certification internationale pour identifier les médias d’information qui respectent les normes éthiques dont le travail est digne de confiance. Plus de 1000 médias, dont CBC/Radio-Canada, y participent. La certification permet aussi de favoriser leur référencement sur Microsoft ou Newsback.

« On entre vraiment dans une nouvelle phase avec l’industrialisation de l’IA, avec des entreprises qui se créent. C’est un secteur qui se développe, mais qui doit être régulé et encadré », estime Vincent Berthier de RSF. Meta a récemment indiqué travailler à la mise en place d’outils pour détecter et étiqueter les images générées par l’IA. Mais quand on voit le laxisme de X, anciennement Twitter, ces derniers mois et la multiplication de réseaux sociaux alternatifs, plusieurs restent sceptiques quant à un véritable contrôle.

« On l’a très bien vu avec le deepfake pornographique de Taylor Swift. Une fois que le contenu est diffusé, c’est très difficile de l’empêcher de circuler. Si même une personnalité comme elle avec énormément de ressources n’arrive pas à contrôler la diffusion de fausses images, alors pour les politiciens et le commun des mortels ça en devient quasi-impossible », juge Marie-Eve Carignan. Mais tout n’est pas à jeter dans l’IA, plusieurs initiatives ont vu le jour durant des élections, comme en 2022 lorsqu’un robot conversationnel avait été créé sur WhatsApp pour inciter les jeunes à s’inscrire sur les listes électorales en France. Reste à voir si ce genre d’initiatives se reproduira cette année.